本日は、AIモデル作成における転移学習についてもう一歩踏み込んで解説してみたいと思います。最近、機械学習や深層学習の分野で注目を集めている転移学習ですが、具体的にどのようなものなのか、またどのように活用されているのかを詳しく見ていきましょう。

転移学習の基本概念

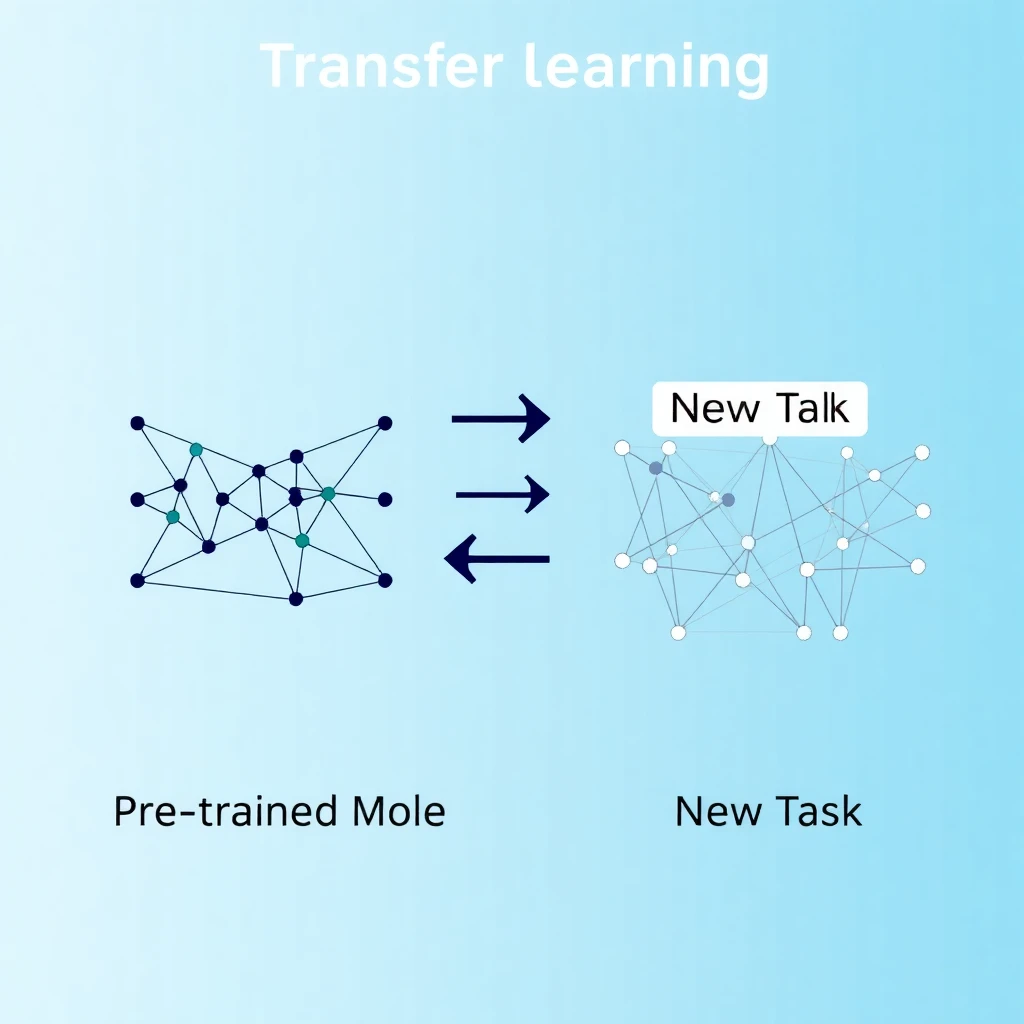

転移学習とは、あるタスクで学習した知識を別の関連するタスクに応用する手法です。例えば、画像認識のモデルが猫の画像を認識するために学習した知識を、犬の画像を認識するために活用することができます。このように、転移学習は既存のモデルを再利用することで、新たにデータを集めたり、長時間の学習を行ったりする必要がなくなります。

転移学習の仕組みは、主に「事前学習」と「ファインチューニング」の2つのステップから成り立っています。事前学習では、大量のデータを用いて一般的な特徴を学習し、その後、特定のタスクに対してファインチューニングを行うことで、モデルの精度を向上させます。

転移学習のメリット

転移学習の最大のメリットは、学習にかかる時間とコストを大幅に削減できる点です。特に、データが少ない場合や、学習に必要なリソースが限られている場合に非常に有効です。また、転移学習を用いることで、少ないデータでも高い精度を達成することが可能になります。

さらに、転移学習は異なるドメイン間での知識の共有を促進します。例えば、医療画像の解析において、一般的な画像認識モデルを利用することで、医療特有のデータに対しても高いパフォーマンスを発揮することができます。

転移学習の活用事例

転移学習はさまざまな分野で活用されています。以下にいくつかの具体的なケーススタディを紹介します。

- 画像認識 : 画像分類タスクにおいて、一般的なデータセット(例えば、ImageNet)で事前学習したモデルを使用し、特定の画像データセット(例えば、医療画像)に対してファインチューニングを行うことで、高精度な分類が可能になります。

- 自然言語処理 : BERTやGPTなどの大規模な言語モデルを用いて、特定のタスク(例えば、感情分析や質問応答)に対して転移学習を行うことで、少ないデータでも高い精度を実現できます。

- 音声認識 : 音声データの特徴を学習したモデルを、異なる言語や方言の音声認識に応用することで、迅速に高精度な音声認識システムを構築することができます。

転移学習の実装方法

転移学習を実装するための基本的なステップは以下の通りです。

- 事前学習モデルの選定 : まず、どのモデルを事前学習に使用するかを決定します。一般的には、ImageNetやCOCOなどの大規模データセットで学習されたモデルが選ばれます。

- データの準備 : 特定のタスクに必要なデータを収集し、前処理を行います。データの質がモデルの性能に大きく影響するため、注意が必要です。

- ファインチューニング : 事前学習モデルを特定のタスクに合わせて再学習させます。この際、学習率やエポック数などのハイパーパラメータを調整することが重要です。

- 評価と改善 : モデルの性能を評価し、必要に応じて改善を行います。過学習を防ぐために、適切なバリデーション手法を用いることが推奨されます。

転移学習の今後の展望

転移学習は今後ますます重要な技術となるでしょう。特に、AI技術が進化する中で、異なるドメイン間での知識の共有が求められています。例えば、医療や自動運転などの分野では、転移学習を活用することで、より迅速かつ高精度なシステムの構築が期待されています。

また、転移学習の技術が進化することで、より少ないデータで高いパフォーマンスを発揮するモデルが登場することが予想されます。これにより、AI技術の普及が加速し、さまざまな分野での応用が進むことでしょう。

転移学習は、AIの未来を切り開く重要な技術の一つです。今後の展開に注目していきたいですね。

本記事は、AI によって生成されました。

本画像は、SD3 によって生成されました。